Issues in Vision Modeling for Perceptual Video Quality Assessment.

Resumen:

Los algoritmos de compresión con pérdida producen artefactos

cuya visibilidad (percepción) depende fuertemente del contenido de la imagen.

RMSE y PSNR ignoran este hecho. Describe y revisa elementos y características

del HVS (Human Visual System) que pueden/se han modelado y que pueden

utilizarse y cómo para PVQA (Perceptual Video Quality Assessment). SNR y RMSE no establecen una correlación buena con las

métricas subjetivas de percepción. Se necesitan métodos y sistemas de

valoración objetiva de la calidad de vídeo cuyas utilidades pueden ser:

- Evaluación, test, y comparación de codecs de video.

- Monitorización y control on-line de la calidad.

- Pruebas de calidad en sistemas de transmisión y

comunicación.

- Compresión de video perceptual

- Restauración de video Perceptual

El objetivo ideal de la valoración objetiva de la calidad de

video debería ser tasar las alteraciones de vídeo tal como lo haría un humano. Las técnicas deben ser independientes del algoritmo, para evitar obsolescencia.

La extremada complejidad del HVS complica los modelos de visión y explica las

diferencias existentes en los PVQA existentes

Relaciona los papers existentes (a la fecha) sobre

quality assessment en imágenes fijas y los más recientes basados en modelos

espacio-temporales del HVS en relación con PVQA.

Discute qué es considerado como calidad por un observador

humano. Luego describe el HVS con relativo detalle, desde su óptica hasta las

neuronas en el V1 (Primary Cortex) y posteriores. Analiza cada uno de los

componentes y/o fenómenos del HVS que pueden ser modelados para PVQA y que

restricciones se aplicarían. Concluye hablando del sistema actual de validación

de sistemas PVQA basado en el VQEG (Visual Quality Experts Group).

Cita (referenciando la ITU-R 500) los procedimientos más comunes (a la fecha) de Validación Subjetiva de la Calidad, e indica cuándo o para qué (en que aplicaciones) son más usados, estos son:

- DSCQS (Double Stimulus Continuous Quality

Scale),

- DSIS (Double Stimulus Impariment Scale)

- SSCQE (Single Stimulus continuous Quality

Evaluation)

En cuanto a la descripción del sistema visual humano y las

implicaciones de cada elemento para el PVQA, habla de

- La óptica del ojo

Para analizar la calidad de la optica del ojo se mide la reflexión del estímulo visual en la retina. La imagen en la retina es una versión distorsionada del estimuo visual. Varias son las distorsiones apreciables. La más significativa es el 'blur' (suavizado). Para medir la cantidad de suavizado se utiliza como estimulo visual un punto para el cual, la imagen en la retina se denomina 'point spread function', cuya transformada de fourier es la 'modulation transfer function'. Westheimer propone una formula simplificada de la 'point spread function'. La cantidad de 'blur' depende de varios factores y autores que en sus formulas incluyen estos factores se referencian.

La 'point spread function' también varia con la longitud de onda. No es posible enfocar correctamente todas las longitudes de onda. Este efecto se denomina 'chromatic aberration'. Puede ser medido mediante la funcion de transferencia del ojo fijando la longitud de onda a la que se acomoda el ojo y variando la apertura de la pupila. Se observa que para la longitud de onda enfocada se obtiene buena resolución espacial, decreciendo ésta conforme las longitudes de onda se alejan de esta y el tamaño de la pupila se incrementa.

Algunos modelos PVQA incorporan la 'point spread function' para suavizar la imagen antes de los demas procesamientos, pero ninguno de los modelos evaluados (hasta la fecha) incorporan la aberrción cromática. Algunos argumentan que el suavizado puede ser considerado en etapas posteriores con un modelado de la sensividad al contraste pero estos modelos ignoran detalles de la forma de la funcion de transferencia y su variación con la longitud de onda.

- Los fotoreceptores

A través de la optica del ojo el estimulo visual llega a la retina que (simplificadamente) esta compuesta por un mosaico de fotoreceptores que muestrean la imagen y la transforman en señales que se interpretaran en fases posteriores.

Hay dos tipos de fotoreceptores, conos y bastones. Los bastones se encargan de la visión con poca luz, normalmente en relación con PVQA sus efectos no se tienen en cuenta. Los conos se encargan de la visión con mucha luz y se concentan en la fovea, zona de mayor agudeza visual y que cubre unos 2 grados del angulo visual en la retina. Hay tres tipos, L, M y S, sensibles a longitudes de onda larga, media y corta respectivamente. Se muestra una grafica de su distribución. Su densidad varia en la retina. Los L y M dominan por toda la retina y en la fovea alcanzan una densidad de 300.000 por mm2 y capturan una frecuencia máxima de 60 cpd (cycles per degree) que es resolución suficiente para capturar todas las variaciones espaciales tras el suavizado. Los S-cones estan mucho mas dispersos y su frecuencia máxima es 3 cpd.

La mayoria de los modelos PVQA descartan esta excentricidad y centra sus modelos concentrandolos en las características de la fovea, puesto que su distribución es más uniforme lo que simplifica el modelado, pero hay que tener en cuenta que 2 grados visuales son mucho menor que la proyección de un televisior sobre la retina.

- La percepción del color

Las tasas de absorción de los distintos conos se separan en señales diferentes en fases tempranas del HVS generando señales independientes, lo que unido a que existe un solape en la sensibilidad a las longitudes de onda por parte de los conos L y M se obtiene que distintos tonos (hues) son procesados juntos mientras que otros nunca pueden ir unidos. Esto conforma la teoria de los colores opuestos apoyada por experimentos psicofísicos y psicologicos. Los componentes principales de el espacio de colores opuestos son el B-W (Black-White), R-G (Red-Green) y B-Y (Blue-Yellow).

El canal B-W codifica luminancia con longitudes de onda de medias-largas. El canal R-G tambien discrimina entre longitudes de onga medias-largas, mientras que el canal B-Y discrimina entre cortas-medias. La mayoría de los experimentos psicofisicos y psicologicos utilizan el modelo de colores opuestos, con lo que los sistemas PVQA que lo utilcen tienen la ventaja de tener sus canales aptados a los estimulos reales, lo que facilita su diseño y analisis.

Alternativamente se pueden usar otros espacios de color, CIE l*u*v y CIE l*a*b, y/o en combinación con los colores opuestos. Estos espacios de color fueron definidos con la intención de poder medir la diferencia en la percepción de color, lo que es una ventaja para modelos PVQA. Se referencia a un autor que muestra que las diferencias entre sistemas PVQA basados unicamente en luminancia frente a otros con el espacio completo de color son muy sutiles. Lo que es de esperar porque la mayoria de los codificadores distribuyen las distorsiones por igual entre canales acromaticos y cromaticos.

Los espacios de color utilizados en la mayoria de los estandares tienen en cuenta caracteriscias del HVS como los colores opuestos y que la agudeza visual del color es mucho menor que la de la luminancia. Ademas el HVS tiene una respuesta no-lineal, casi logaritmica a la intensidad. Casualmente esa sensibilidad a la luminosidad del HVS coincide con la corrección gamma (inversa de la funcion presentada) de los CRT. Por eso codificar información visual en el dominio de correción-gamma es significativo perceptualmente y compensa la no linealidad de los CRT.

La ITU-R Recomendation 601 defiine el espacio de color YCbCr donde Y codifica luminancia y Cb y Cr las diferencias entre luminancia y el azul primario y rojo primario respectivamente. Como este modelo asume la distribución power spectrum del dispositivo que la emite se dan conversiones a los triestimulos CIE X Y Z mostradas en el apendice.

- La sensibilidad al contraste

El contraste es una medida de la variación relativa de luminancia. No hay una definición (formulación) única de contraste. En fucnión del tipo de estimulo existen distintas formulaciones de contraste.

Muestra las formulas de Micheldson y Weber para patrones periodicos de desviaciones simetricas de luminosidad y para incrementos simples sobre una luminosidad constante respectivamente. Ademas no

son equialentes ni tienen los mismos rangos de valor. Micheldson tiene un rango de 0 a 1 y Weber de -1 a Inf. Ademas ninguno de los modelos se ajusta bien para imagenes complejas (naturales) ya que

los valores extremos determinan el contraste de toda la imagen. Ademas el HVS tiene la sensibilidad al contraste adaptada a la luminancia local media. Peli propone una medida paso banda local

del contraste, cuya formulacion expone. Modificaciones de esta formulación ha sido usada en sistemas PVQA con exito, refs [21,66].

La sensibilidad al contraste depende del color y de la frecuencia espacial y temporal del estímulo. Las funciones de sensibilidad al contraste (Contrast Sensitivity Funcitions CSF) se utilizan para

cuantificar estas diferencias. Se definen como la inversa del umbral de contraste que es el contraste necesario para un observador para detectar un objetivo. Comenta la respuesta a frecuencias

espacio-temporales de las funciones CSF, de forma que la sensibilidad al contraste decrece conforme se incrementa la frecuencia espacio-temporal. También habla de la diferencia en respuesta

cromática y acromática. La completa gama de colores solo se percibe a bajas frecuencias. Comenta los debates que ha habido sobre la separabilidad de la frecuencia temporal y la espacial en las

funciones CSF y presenta varios trabajos que derivan en dicha separabilidad. También comenta que las funcioes CSF son sensibles a los micro-movimientos oculares y presenta varios

trabajos que los modelan repercutiendo sustancialmente en la forma de las funciones CSF espacio-temporales.

Los sistemas PVQA incorporan estas funciones de sensibilidad al contraste en sus modelos. Basicamente de dos formas. Una estableciendo la ganancia del filtro de cada banco en un

entorno multicanal de forma que se parezca a los resultados experimentales. Otra es prefiltrar los canales B-W, R-G y B-Y con sus respectivas CSF y luego calibrarlas.

El primer metodo tiene una implementación mas eficiente mientras el segundo se aproxima mas a la forma de la funcion CSF espacio-temporal.

Comenta que los modelados del HVS basados en teorías de

resolución única (single-resolution theories) no explican los datos y

patrones complejos obtenidos empíricamente, y que la teoría de visión de

multi-resolución, que emplea diferentes conjuntos de filtros en vez de uno

solo, si puede explicarlos. Estos conjuntos de filtros se basan en:

- Mecanismos espaciales del HVS

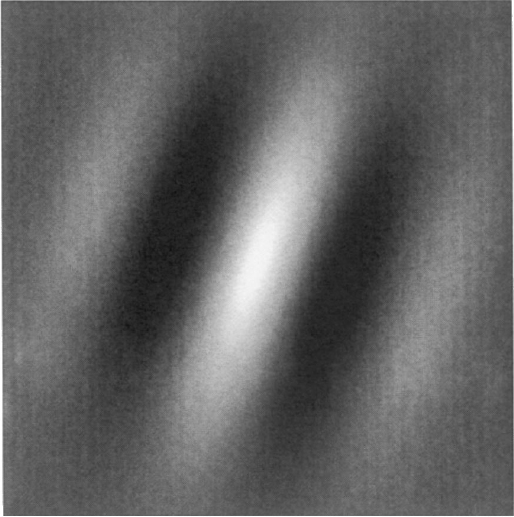

Las "simple-cells" son neuronas del primary visual cortex que tienen un campo receptivo compuesto por bandas o regiones excitatorias e inhibidoras alargadas y con

orientación, como muestra en la figura.

Fig 1. Campo receptivo de las simple-cells |

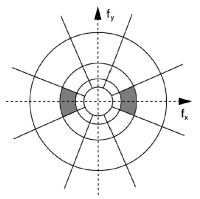

Fig 2. Particionamiento del plano de frecuencias |

Actuan como filtros paso banda con una determinada orientación que responden a un conjunto de frecuencias y orientaciones relativas a su valor central. Todavia se discute acerca de la distribución, forma exacta y ancho de banda. Distintos experimentos psicofisicos dan distintos resultados.

Estos resultados experimentales tambien afloran de las estadísticas de imagenes naturales. Habla sobre las frecuencias espaciales, la separacion en canales y las distintas orientaciones. Y concluye que por razones de implementación la distribución puede ser la misma para canales cromaticos y acromaticos. Muestra un ejemplo del particionamiento del plano de frecuencias y orientaciones de una implementacion concreta de un sistema PVQA.

- Mecanismos temporales del HVS

Los mecanismos temoporales del HVS también han sido estudiados, aunque con menor acuerdo que los espaciales. Actualmente las teorias predominantes indican la existencia de dos

canales llamados "sostenido" y "de transición". Experimentos psicologicos confirman estos hallazgos. Habla sobre las frecuencias de estos canales y muestra el modelo de

Fredriksen y Hess basado en derivadas de la funcion de impulso.

- Diseño de Filtros

Los mecanismos anteriores del HVS pueden incorporarse en sistemas PVQA via un banco de filtros. Comenta como se pueden organizar estos filtros, que la suma de estos debería

ser 1 para poder independizar el diseño de las funciones CSF de la descomposición de los filtros. Ademas la invertibilidad es deseable para aplicaciones en las que deba

haber recostrucción.

Algunos campos receptivos del HVS están dispustos en una frecuencia espacial y orientación determinada, y su perfil recuerda a funciones Gabor bidimeinsionales (Fig 1.).

Se postula que los filtros corticales actuan para minimizar el producto conjunto de la desviación estandar espacial y la sensibilidad a la frecuencia espacial, de acuerdo al

principio de incertidumbre del analisis de Fourier. Por tanto las transformadas de Gabor son una posible opción implementable. Aunque desde un punto de vista práctico se

han consolidado otras implementaciones. Comenta varias de ellas como la transformada de cortex introducida por watson con una estructura piramidal de los filtros que busca

reducir el coste computacional. Simoncelli et al. también proponen una estructura de filtros piramidal invariante a las traslaciones y rotaciones, auto-invertible y sin efecto

aliasing, para cualquier numero de bandas. Sigue comentando los pros y los contras de estas y otras implementaciones practicas.

- Mecanismos espacio-temporales del HVS.

¿Cómo se pueden incorporar en los canales de una arquitectura multiresolución las interacciones de los canales espacio-temporales mostradas por las medidas de las CSF?

Hay dos teorias, "Sensitiviti-scaling hypotesis" y la "Covariation hypotesis". La primera dice que los filtros temporales tienen una ganancia pico independiente de las

frecuencias espaciales, por lo que se pueden tratar independientemente el espacio y el tiempo. Es la más utilizada por su simplicidad respecto la otra. La segunda dice

que el ensamblado de los filtros sigue una covarianza espacio-temporal con una disposición determinada que impide el tratamiento independiente, aunque ofrece un modelado

de los mecanismos visuales mas preciso. Para esta aproximación las estructuras de filtros espaciales, como las piramidales comentadas anteriormente, se pueden extender a

la dimensión temporal.

Continua hablando de otras características del HVS a tener en cuenta en los modelso PVQA, como:

- Enmascaramiento

El enmascaramiento es un fenómeno importante en general en visión y en particular en los sistemas PVQA porque describe la interacción de los estímulos visuales. El

enmascaramiento ocurre cuando un estímulo que es visible por si solo, no puede detectarse debido a la presencia de otro estímulo. A veces el efecto contrario, "facilitation"

se puede dar, es decir, se aprecia un estímulo que por si solo no es visible gracias a la presencia de otro.

En el framwork de la valoración de la calidad (Quality Assessment) es util pensar en el ruido producido por la codificación como enmascaramiento o facilitación de la imagen

o secuencia original cuando actua como fondo. El enmascaramiento explica porque ciertas distorsiones producidas por la codificación se aprecian mucho en ciertas regiones de la

imgen mientras en otras o el reso son casi inapreciables. Existen dos tipos de enmascaramiento, el espacial y el temporal.

- Enmascaramiento Espacial

Muchos modelos de visión limitan el enmascaramiento a un unico canal. Experimentos psicofisicos muestran que se produce enmascaramiento entre canales de distinta orienación,

frecuencia, crominancia y luminancia.

Existen modelos que modelan el enmascaramiento emulando el proceso de inhibición lateral de ganancia de contraste de ciertas neuronas, que consiguen mantener los niveles

de contraste en los máximos permitidos pero la acción inhibidora de las neuronas colindantes generan enmascaramiento. Watson y Solomon [119], presentaron una generalización

de estos modelos permitiendo la integracion e interacción de canales con distinta frecuencia, color, luminancia, orientación y localización. Se explica someramente su formulación

y se comenta que esta implementación del control de ganancia de contraste ha sido utilizada con exito por el autor en imagenes en color y video. Otros autores implementan otro

tipo de control de ganancia de contraste. Ciertos enmascaramientos, producidos por estimulos sencillos (rejillas sinusoidales, mascaras de Gabor) pueden ser modelados con

una u otra forma de control de ganancia de contraste, pero muchos otros tipos de enmascaramientos (dados en estimulos complejos como imagenes naturales) no pueden ser

reproducidos de esta forma. Otros tipos de enmascaramiento espacial se discuten en [58].

- Enmascaramiento Temporal

El enmascaramiento temporal es una elevación de los umbrales de visibilidad producida por una discontinuidad temporal en la escena, por ejemplo un corte de escena. Seyler y

Budrikis [96,97] concluyen que la elevación de contraste tras una transición de negro a blanco o

viceversa puede llegar a varios cientos de milisegundos desde la transición, lo provoca una distorsión perceptual respecto la realidad. Mas recientemente [107] se ha

investigado los efectos, tras un cambio de escena, de los artefactos introducidos por la codificación MPEG2 y se han encontrado efectos de enmascaramiento en los siguientes

frames tras el cambio. Continua con otros estudios al respecto, comentando que el enmascaramiento temporal ha sido menos aplicado a PVQA, aunque algunos autores como

Girod [38] y Watson [118] han modelado enmascaramiento temporal.

- Adaptación de Patrones

La adaptación de patrones es el efecto que se produce por el ajuste de sensibilidad al contraste del sistema visual en respuesta a la estimulación continua con un patron de

determinada frecuencia. Esto puede lleva a perdida de sensibilidad de contraste alrededor de dicha frecuencia. Este efecto, junto con el enmascaramiento ha llevado al modelo

de multiresolución.

La arquitectura multiresolución no tienen en cuenta otros aspectos temporales de la adpatación a patrones y estas caracteristicas deben ser introducidas a parte en el

modelo. Diversos autores han proporcionado modelos que tienen en cuenta la adaptación a patrones, como son Webster y Miyahara [123] que con escenas naturales y enfoques lejanos

y cercanos a los que adaptarse muestran una perdida de sensibilidad en frecuencias bajas-medias. También Webster and Mollon [124] hacen un estudio de la adpatación a patrones

cromaticos en las escenas naturales.

- Pooling

Hasta ahora todos los procesos mencionados tienen lugar en el Primary Cortex o Area V1 del cerebro. Se sabe que la integración de los distintos canales se realiza en areas

posteriores, comenzando por la V2. Esto se puede simular con ponderaciones basadas en reglas probabilisticas o como suma de vectores en un proceso llamado pooling. Pero para

las aproximaciones matemáticas de esta índole que se presentan (Regla de suma de probabilidades, o el sumatorio de Minkoswski), no se tienen evidencias experimentales psicofisicas

o psicologicas que las corroboren todavía.

- El proceso cognitivo

El proceso cognitivo humano no puede ser obviado en sistemas PVQA avanzados. Este proceso puede variar sustancialmente entre individuos y situaciones lo que hace dificil

su generalización. Hay componentes de este proceso que pueden tenerse en cuenta, como el desplazamiento del foco de atención y el seguimiento de objetos moviles.

Aunque el posicionamiento del punto de atención es inherente al individuo, grupos de individuos (en función del contenido de la escena) focalizan

las mismas regiones de la escena. Maeder et al. [70] proponen la construcción de un mapa de interes basandose en factores como la intensidad de los bordes,

energía de las texturas, variaciones de contraste y color, homogeneidad, etc.

Los objetos en movimiento captan la atención de los sujetos. La agudeza visual del HVS depende inversamente de la velocidad de la imagen en la retina. Esto es aliviado

mediante un movimiento ocular de seguimiento suave para mantener el objeto de interes sobre la fovea. Las grandes aceleraciones y movimientos indeterministas afectan a

este proceso. Por otro lado el seguimiento de objetos reduce la agudeza visual con la que se procea el fondo y de objetos que se muevan en otra dirección. Una adaptacón

de las funciones CSF pueden ser un primer paso en el modelado de este fenomeno [22,127]

Finalmente habla brevemente de la dificultad de estandarizar los modelos presentados y del origen y objetivos del VQEG (Video Quality Expert Group)

Bibliografía:

|

[Snowden_Hammett_1995] |

Spatial Frecuency Adaptation: Threshold Elevation and Perceived Contrast |

|